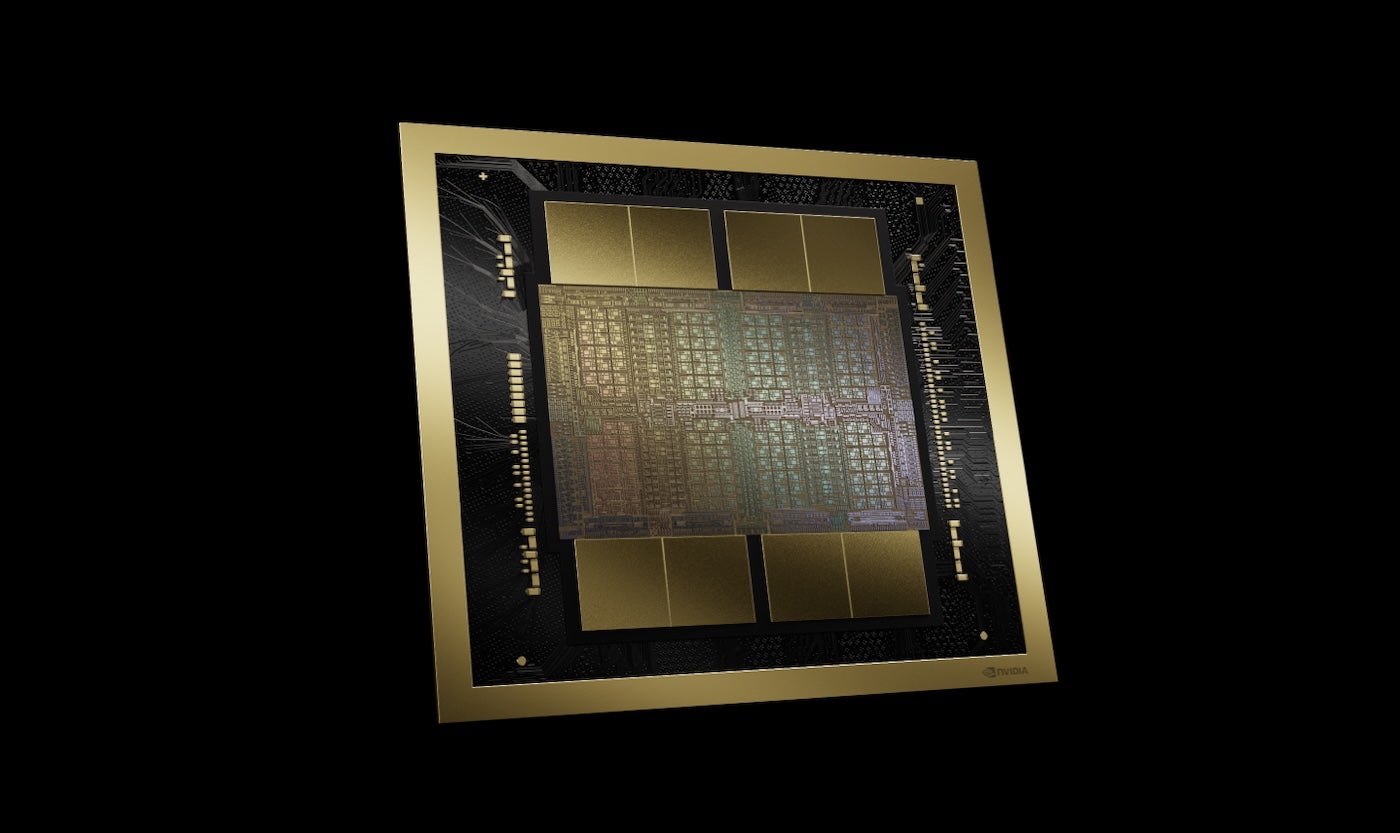

La dernière plate-forme GPU de NVIDIA est le Blackwell (Figure A), que des sociétés comme AWS, Microsoft et Google envisagent d’adopter pour l’IA générative et d’autres tâches informatiques modernes, a annoncé le PDG de NVIDIA, Jensen Huang, lors du discours d’ouverture de la conférence NVIDIA GTC le 18 mars à San Jose, en Californie.

Figure A

Les produits basés sur Blackwell entreront sur le marché auprès des partenaires NVIDIA du monde entier fin 2024. Huang a annoncé une longue gamme de technologies et de services supplémentaires de NVIDIA et de ses partenaires, parlant de l’IA générative comme d’une seule facette de l’informatique accélérée.

“Lorsque vous accélérez, votre infrastructure est constituée de GPU CUDA”, a déclaré Huang, faisant référence à CUDA, la plate-forme de calcul parallèle et le modèle de programmation de NVIDIA. “Et lorsque cela se produit, il s’agit de la même infrastructure que pour l’IA générative.”

Blackwell permet la formation et l’inférence de grands modèles de langage

La plate-forme GPU Blackwell contient deux puces connectées par une interconnexion puce à puce de 10 téraoctets par seconde, ce qui signifie que chaque côté peut fonctionner essentiellement comme si « les deux puces pensaient qu’il s’agissait d’une seule puce », a déclaré Huang. Il contient 208 milliards de transistors et est fabriqué à l’aide du processus TSMC 4NP de 208 milliards de NVIDIA. Il dispose d’une bande passante mémoire de 8 To/S et de 20 pentaFLOPS de performances IA.

Pour les entreprises, cela signifie que Blackwell peut effectuer des formations et des inférences pour des modèles d’IA évoluant jusqu’à 10 000 milliards de paramètres, a déclaré NVIDIA.

Blackwell est amélioré par les technologies suivantes :

- La deuxième génération du TensorRT-LLM et du NeMo Megatron, tous deux de NVIDIA.

- Des frameworks permettant de doubler la taille des calculs et des modèles par rapport au moteur de transformateur de première génération.

- Informatique confidentielle avec protocoles de cryptage d’interface natifs pour la confidentialité et la sécurité.

- Un moteur de décompression dédié pour accélérer les requêtes de base de données dans l’analyse des données et la science des données.

Concernant la sécurité, Huang a déclaré que le moteur de fiabilité « effectue un auto-test, un test dans le système, de chaque bit de mémoire de la puce Blackwell et de toute la mémoire qui y est attachée. C’est comme si nous avions livré la puce Blackwell avec son propre testeur.

Les produits basés sur Blackwell seront disponibles auprès des fournisseurs de services cloud partenaires, des sociétés du programme NVIDIA Cloud Partner et de certains cloud souverains.

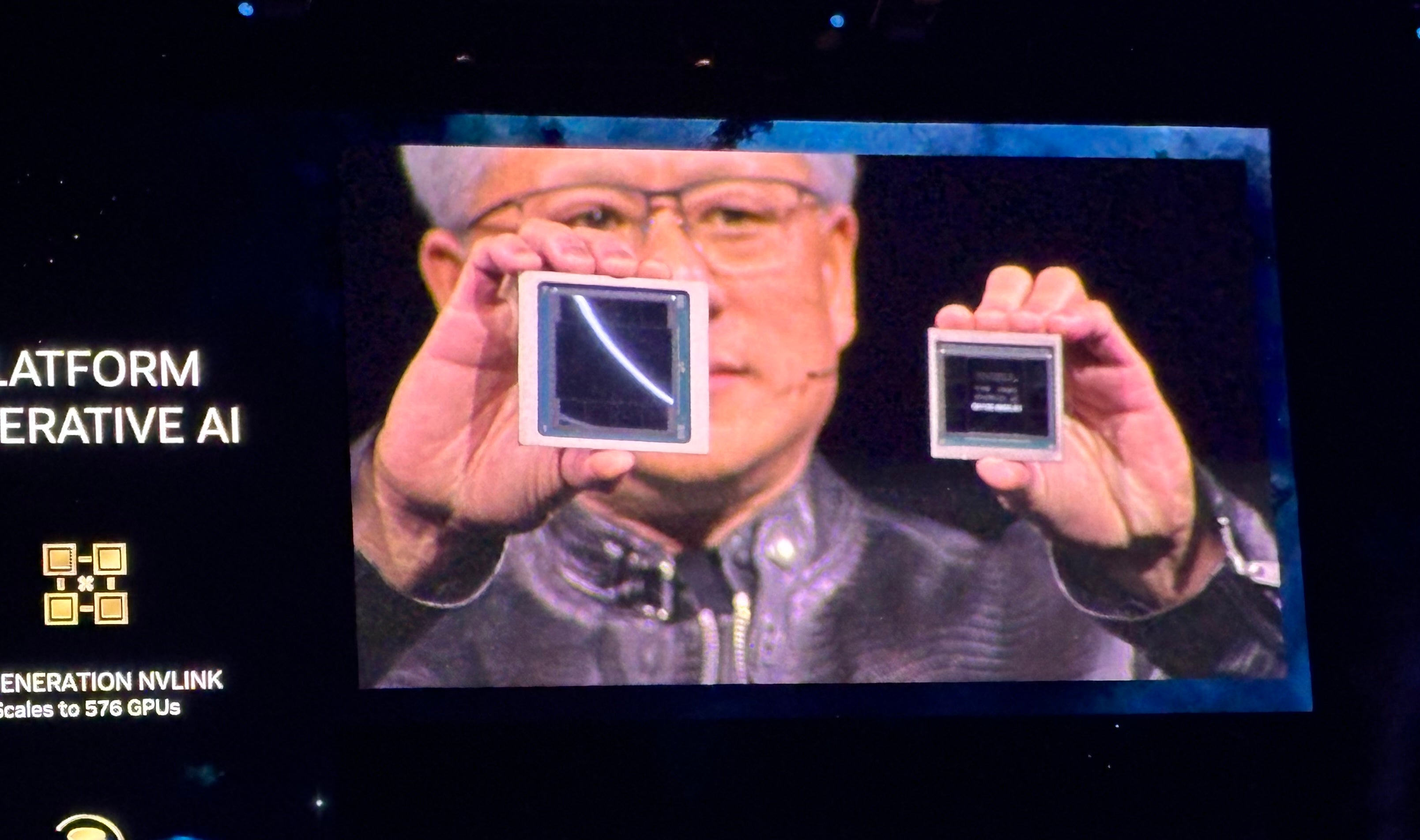

La gamme de GPU Blackwell suit la gamme de GPU Grace Hopper, qui a fait ses débuts en 2022 (Figure B). NVIDIA affirme que Blackwell exécutera une IA générative en temps réel sur des LLM comportant des milliards de paramètres à un coût 25 fois inférieur et à une consommation d’énergie inférieure à celle de la gamme Hopper.

Figure B

NVIDIA GB200 Grace Blackwell Superchip connecte plusieurs GPU Blackwell

Parallèlement aux GPU Blackwell, la société a annoncé le NVIDIA GB200 Grace Blackwell Superchip, qui relie deux GPU NVIDIA B200 Tensor Core au processeur NVIDIA Grace, fournissant ainsi une nouvelle plate-forme combinée pour l’inférence LLM. La superpuce NVIDIA GB200 Grace Blackwell peut être liée aux nouvelles plates-formes Ethernet NVIDIA Quantum-X800 InfiniBand et Spectrum-X800 de la société pour des vitesses allant jusqu’à 800 Go/s.

Le GB200 sera disponible sur NVIDIA DGX Cloud et via les instances AWS, Google Cloud et Oracle Cloud Infrastructure plus tard cette année.

La nouvelle conception du serveur anticipe les modèles d’IA comportant des milliards de paramètres

Le GB200 est l’un des composants du GB200 NVL72 récemment annoncé, une conception de serveur à l’échelle rack qui regroupe 36 processeurs Grace et 72 GPU Blackwell pour 1,8 exaFLOP de performances IA. NVIDIA envisage des cas d’utilisation possibles pour des LLM massifs comportant des milliards de paramètres, notamment la mémoire persistante des conversations, les applications scientifiques complexes et les modèles multimodaux.

Le GB200 NVL72 combine la cinquième génération de connecteurs NVLink (5 000 câbles NVLink) et la superpuce GB200 Grace Blackwell pour une puissance de calcul massive. Huang appelle « un système d’IA exoflops dans un seul rack ».

“C’est plus que la bande passante moyenne d’Internet… nous pourrions pratiquement tout envoyer à tout le monde”, a déclaré Huang.

« Notre objectif est de réduire continuellement le coût et l’énergie – ils sont directement corrélés les uns aux autres – de l’informatique », a déclaré Huang.

Le refroidissement du GB200 NVL72 nécessite deux litres d’eau par seconde.

La prochaine génération de NVLink apporte une architecture de centre de données accélérée

La cinquième génération de NVLink offre un débit bidirectionnel de 1,8 To/s par communication GPU entre 576 GPU maximum. Cette itération de NVLink est destinée à être utilisée pour les LLM complexes les plus puissants disponibles aujourd’hui.

« À l’avenir, les centres de données seront considérés comme une usine d’IA », a déclaré Huang.

Présentation des microservices d’inférence NVIDIA

Un autre élément de l’éventuelle « usine IA » est le microservice d’inférence NVIDIA, ou NIM, que Huang a décrit comme « une nouvelle façon pour vous de recevoir et de conditionner des logiciels ».

Les NIM de NVIDIA sont des microservices contenant les API, le code spécifique au domaine, les moteurs d’inférence optimisés et le runtime d’entreprise nécessaires à l’exécution de l’IA générative. Ces microservices cloud natifs peuvent être optimisés en fonction du nombre de GPU utilisés par le client et peuvent être exécutés dans le cloud ou dans un centre de données détenu. Les NIM permettent aux développeurs d’utiliser les API, NVIDIA CUDA et Kubernetes dans un seul package.

VOIR : Python reste le langage de programmation le plus populaire selon l’indice TIOBE. (TechRépublique)

Les NIM exploitent l’IA pour créer l’IA, rationalisant ainsi certains travaux lourds tels que l’inférence et la formation nécessaires à la création de chatbots. Grâce aux bibliothèques CUDA spécifiques à un domaine, les NIM peuvent être personnalisés pour des secteurs très spécifiques tels que la santé.

Au lieu d’écrire du code pour programmer une IA, a déclaré Huang, les développeurs peuvent « constituer une équipe d’IA » qui travaillent sur le processus au sein du NIM.

« Nous voulons créer des chatbots – des copilotes d’IA – qui travaillent aux côtés de nos concepteurs », a déclaré Huang.

Les NIM sont disponibles à partir du 18 mars. Les développeurs peuvent expérimenter les NIM gratuitement et les exécuter via un abonnement NVIDIA AI Enterprise 5.0. Les NIM sont disponibles dans Amazon SageMaker, Google Kubernetes Engine et Microsoft Azure AI, et peuvent interagir avec les frameworks d’IA Deepset, LangChain et LlamaIndex.

Nouveaux outils publiés pour NVIDIA AI Enterprise dans la version 5.0

NVIDIA a lancé la version 5.0 d’AI Enterprise, sa plateforme de déploiement d’IA destinée à aider les organisations à déployer des produits d’IA générative auprès de ses clients. 5.0 de NVIDIA AI Enterprise ajoute ce qui suit :

- NIM.

- Microservices CUDA-X pour une grande variété de cas d’utilisation de l’IA accélérée par GPU.

- AI Workbench, une boîte à outils pour les développeurs.

- Prise en charge de la plateforme Red Hat OpenStack.

- Prise en charge étendue des nouveaux GPU NVIDIA, du matériel réseau et des logiciels de virtualisation.

L’opérateur de grands modèles de langage de génération augmentée par récupération de NVIDIA est désormais en accès anticipé pour AI Enterprise 5.0.

AI Enterprise 5.0 est disponible via Cisco, Dell Technologies, HP, HPE, Lenovo, Supermicro et d’autres fournisseurs.

Autres annonces majeures de NVIDIA au GTC 2024

Huang a annoncé une large gamme de nouveaux produits et services en matière de calcul accéléré et d’IA générative lors du discours d’ouverture de NVIDIA GTC 2024.

NVIDIA a annoncé cuPQC, une bibliothèque utilisée pour accélérer la cryptographie post-quantique. Les développeurs travaillant sur la cryptographie post-quantique peuvent contacter NVIDIA pour obtenir des mises à jour sur la disponibilité.

La série de commutateurs réseau X800 de NVIDIA accélère l’infrastructure de l’IA. Plus précisément, la série X800 contient les commutateurs Ethernet NVIDIA Quantum-X800 InfiniBand ou NVIDIA Spectrum-X800, le commutateur NVIDIA Quantum Q3400 et le NVIDIA ConnectXR-8 SuperNIC. Les commutateurs X800 seront disponibles en 2025.

Les principaux partenariats détaillés lors du discours d’ouverture de NVIDIA comprennent :

- La plateforme IA full-stack de NVIDIA sera disponible sur Enterprise AI d’Oracle à partir du 18 mars.

- AWS donnera accès aux instances Amazon EC2 basées sur GPU NVIDIA Grace Blackwell et à NVIDIA DGX Cloud avec la sécurité Blackwell.

- NVIDIA va accélérer Google Cloud avec la plate-forme informatique NVIDIA Grace Blackwell AI et le service NVIDIA DGX Cloud, arrivant sur Google Cloud. Google n’a pas encore confirmé de date de disponibilité, même si elle devrait être fin 2024. De plus, la plate-forme DGX Cloud basée sur NVIDIA H100 est généralement disponible sur Google Cloud à partir du 18 mars.

- Oracle utilisera NVIDIA Grace Blackwell dans son OCI Supercluster, OCI Compute et NVIDIA DGX Cloud sur Oracle Cloud Infrastructure. Certains services d’IA souverains combinés Oracle-NVIDIA sont disponibles depuis le 18 mars.

- Microsoft adoptera la superpuce NVIDIA Grace Blackwell pour accélérer Azure. La disponibilité peut être attendue plus tard en 2024.

- Dell utilisera l’infrastructure et la suite logicielle d’IA de NVIDIA pour créer Dell AI Factory, une solution d’entreprise d’IA de bout en bout, disponible à partir du 18 mars via les canaux traditionnels et Dell APEX. À un moment futur non divulgué, Dell utilisera la superpuce NVIDIA Grace Blackwell comme base pour une architecture rackable, haute densité et refroidie par liquide. Le Superchip sera compatible avec les serveurs PowerEdge de Dell.

- SAP ajoutera des capacités de génération augmentée par récupération NVIDIA dans son copilote Joule. De plus, SAP utilisera les NIM NVIDIA et d’autres services communs.

“L’ensemble de l’industrie se prépare pour Blackwell”, a déclaré Huang.

Concurrents des puces IA de NVIDIA

NVIDIA est principalement en concurrence avec AMD et Intel en ce qui concerne la fourniture d’IA d’entreprise. Qualcomm, SambaNova, Groq et une grande variété de fournisseurs de services cloud jouent dans le même espace en ce qui concerne l’inférence et la formation génératives de l’IA.

AWS possède ses plateformes propriétaires d’inférence et de formation : Inferentia et Trainium. En plus de s’associer à NVIDIA sur une grande variété de produits, Microsoft possède sa propre puce de formation et d’inférence en IA : le Maia 100 AI Accelerator dans Azure.

Clause de non-responsabilité: NVIDIA a payé mon billet d’avion, mon hébergement et certains repas pour l’événement NVIDIA GTC qui s’est tenu du 18 au 21 mars à San Jose, en Californie.